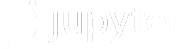

DÉCOUVREZ LES PUISSANTS COMPOSANTS

DU SYSTÈME DGX A100

01.

8 GPU NVIDIA A100 AVEC 320 GO DE MÉMOIRE GPU TOTALE

12 liaisons NVLink par GPU, 600 Go/s de bande passante GPU-vers-GPU

02.

6 MODULES NVSWITCH DE SECONDE GÉNÉRATION

4,8 To/s de bande passante bidirectionnelle, soit 2 fois plus que la génération précédente

03.

9 adaptateurs Mellanox ConnectX-6 VPI HDR InfiniBand 200Gb Ethernet

225 Go/s de bande passante bidirectionnelle maximale

04.

DEUX CPU AMD 0 64 CŒURS ET 1 TO DE MÉMOIRE SYSTÈME

2,7x plus de cœurs pour prendre en charge les opérations d’IA les plus intensives

05.

DISQUES SSD NVME GEN4 DE 15 TO

25,6 Go/s de bande passante maximale, 2x plus rapide qu’un SSD NVME Gen3

Pour voir toutes les spécifications

innovations technologiques

Principaux frameworks pré-installés

Essentiel pour les data centers dédiés à l'IA

Performances révolutionnaires

Analyse de données

PageRank

Graph Edges per Second (Billions)

3,000X CPU Servers vs. 4X DGX A100. Published Common Crawl Data Set: 128B Edges, 2.6TB Graph.

Entraînement

NLP: BERT-Large

Sequences per Second

BERT Pre-Training Throughput using PyTorch including (2/3)Phase 1 and (1/3)Phase 2. Phase 1 Seq Len = 128, Phase 2 Seq Len = 512. V100: DGX-1 with 8X V100 using FP32 precision. DGX A100: DGX A100 with 8X A100 using TF32 precision.

Inférence

Peak Compute

TeraOPS per Second

CPU Server: 2X Intel Platinum 8280 using INT8. DGX A100: DGX A100 with 8X A100 using INT8 with Structural Sparsity.